+200 Cours vidéos, études de cas, templates...

Accéder gratuitement 👉

+200 Cours vidéos, études de cas, templates...

Accéder gratuitement 👉

🎁 Formez-vous en continu à l'UX Design et au CRO (Optimisation des conversions)

Florent Kiecken

11/3/2024

Dernière MAJ :

5/5/2026

Découvrez nos services d'audit CRO pour booster vos conversons à coup sûr grâce à de vrais insights.

+3500 inscrits

Un audit CRO bien mené, c'est la différence entre deviner ce qui ne va pas sur ton site et le savoir. C'est aussi la différence entre des A/B tests qui échouent à répétition et des optimisations qui génèrent un vrai impact business.

Dans ce guide, on va décortiquer tout le processus : ce qu'est réellement un audit CRO, pourquoi la recherche est le pilier de toute stratégie d'optimisation, les méthodes concrètes à utiliser, et comment transformer des données brutes en actions qui font bouger les métriques.

Un audit CRO (Conversion Rate Optimization), c'est une évaluation méthodique de l'expérience utilisateur et des parcours de conversion d'un site web. L'objectif : identifier ce qui empêche les visiteurs de convertir, comprendre pourquoi, et formuler des hypothèses d'optimisation basées sur des données réelles.

Ce n'est pas une checklist de bonnes pratiques qu'on applique à l'aveugle. Ce n'est pas non plus un audit purement technique ou SEO. Un audit CRO, c'est un travail d'investigation. On cherche à comprendre le comportement des utilisateurs, leurs motivations, leurs hésitations, et les frictions qu'ils rencontrent.

La nuance est importante : beaucoup de gens confondent "audit CRO" avec "liste de recommandations UX génériques". Le problème de cette approche, c'est qu'elle ignore le contexte. Chaque site, chaque audience, chaque offre est différente. Une recommandation qui fonctionne sur un e-commerce B2C n'aura pas le même effet sur un SaaS B2B. L'audit CRO, lui, part des données spécifiques à ton site pour arriver à des recommandations spécifiques à ta situation.

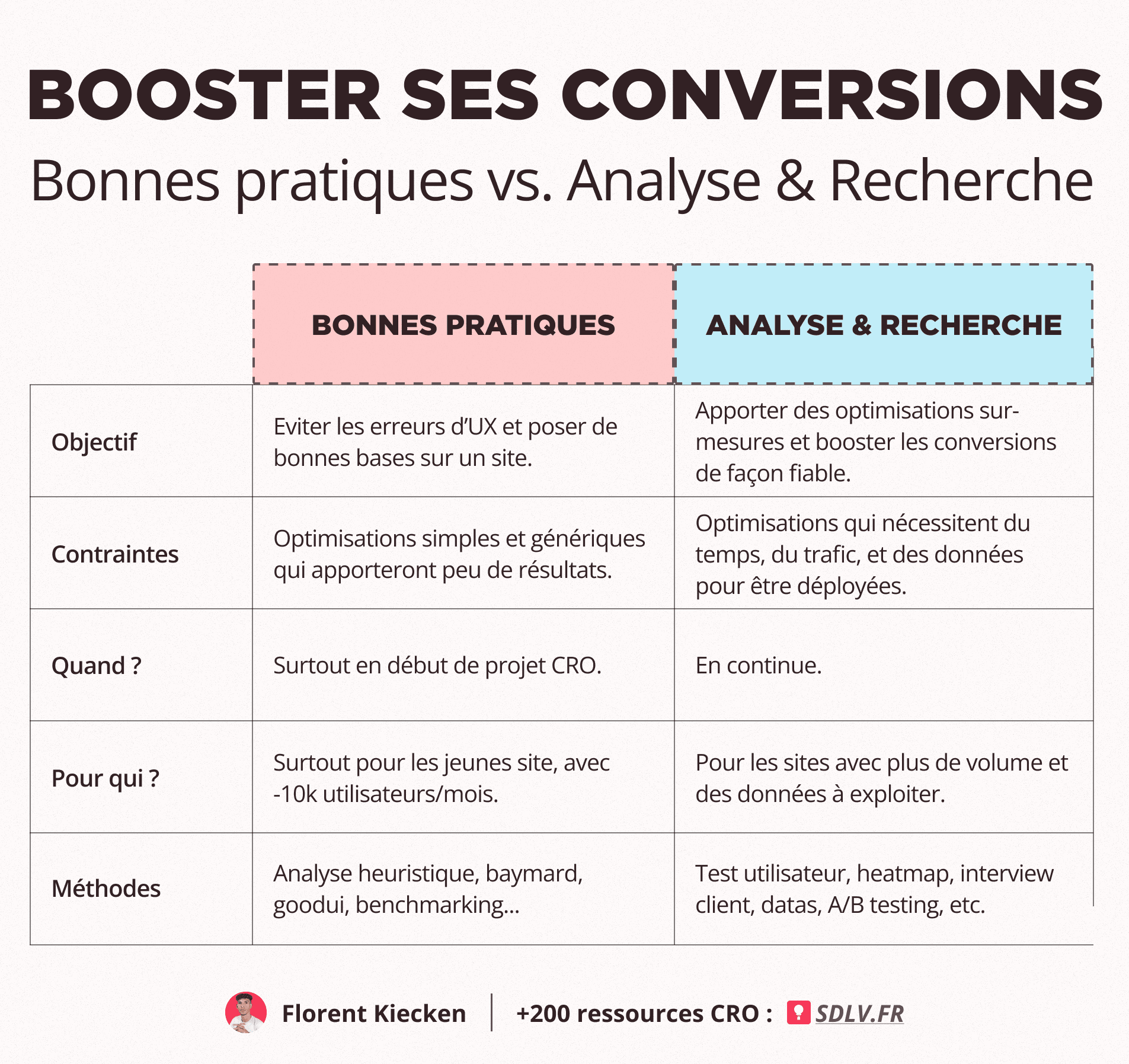

Et surtout, il faut comprendre une chose fondamentale : le CRO, c'est 80% de travail invisible. La partie que les utilisateurs voient — les modifications de design, les nouveaux textes, les A/B tests — ce n'est que la partie émergée de l'iceberg. En dessous, il y a tout un processus d'analyse, de recherche et de réflexion qui fait la qualité des optimisations.

Le problème que je vois le plus souvent chez les entreprises qui "font du CRO" : elles passent directement à l'exécution. On change un bouton, on teste un titre, on réorganise une page — sans avoir pris le temps de comprendre ce qui se passe réellement.

Résultat : des tests qui échouent, des ressources gaspillées, et une frustration croissante. On finit par conclure que "le CRO ne marche pas chez nous".

Le vrai problème, c'est qu'on a sauté l'étape la plus importante : la recherche.

Investir dans un audit CRO structuré, ça apporte trois choses concrètes. D'abord, une compréhension réelle des problèmes. On ne devine plus, on sait ce qui bloque les utilisateurs. Ensuite, une priorisation éclairée. Quand on comprend l'impact potentiel de chaque problème, on sait où mettre son énergie en premier. Et enfin, des tests beaucoup plus pertinents. Un test basé sur un vrai insight utilisateur a bien plus de chances de gagner qu'un test basé sur une intuition ou une "best practice" lue sur un blog.

L'audit CRO n'est pas un exercice ponctuel qu'on fait une fois puis qu'on oublie. C'est le point de départ d'un programme d'optimisation continu. La recherche alimente les hypothèses, les tests valident ou invalident ces hypothèses, et les résultats nourrissent de nouveaux insights. C'est un cycle vertueux.

Avant de plonger dans les méthodes, il faut comprendre le processus global dans lequel s'inscrit l'audit. C'est un enchaînement de 5 étapes, chacune alimentant la suivante.

Étape 1 : L'analyse globale. On commence par prendre du recul. Le benchmarking permet de se situer par rapport au marché et à la concurrence. L'analyse heuristique consiste à évaluer le site à travers des grilles de critères éprouvées — clarté de la proposition de valeur, niveau de friction dans les parcours, pertinence du contenu par rapport à la cible, éléments de motivation et de réassurance, valeur perçue de l'offre. C'est une première passe d'expert qui permet d'identifier les problèmes les plus évidents.

Étape 2 : La recherche quantitative. On plonge dans les données. Analytics pour comprendre les flux de trafic et identifier les pages problématiques. Heatmaps pour voir où les utilisateurs cliquent, scrollent et s'arrêtent. Session recordings pour observer les comportements réels et repérer les points de friction. L'objectif ici, c'est de comprendre le "quoi" : que font les utilisateurs sur le site ?

Étape 3 : La recherche qualitative. C'est là qu'on comprend le "pourquoi". Les interviews clients permettent de creuser les motivations profondes et les freins à l'achat. Les surveys et enquêtes on-site captent les hésitations et les questions que se posent les visiteurs en temps réel. Les tests utilisateurs révèlent les frictions et les points de confusion que les données seules ne montrent pas.

Étape 4 : La mise en place de la roadmap. On rassemble tout. On catégorise les problèmes identifiés, on formule des hypothèses d'optimisation, et on priorise selon l'impact potentiel, le niveau de confiance et l'effort requis.

Étape 5 : L'intégration. C'est la partie visible. On traduit les hypothèses en modifications concrètes — redesign UX/UI, refonte du copywriting, mise en place d'A/B tests, personnalisation de l'expérience. C'est seulement à cette étape que les utilisateurs voient un changement.

Le point essentiel à retenir : les étapes 1 à 3 constituent le cœur de l'audit. C'est là que se construit la compréhension. Et c'est cette compréhension qui détermine la qualité de tout ce qui suit.

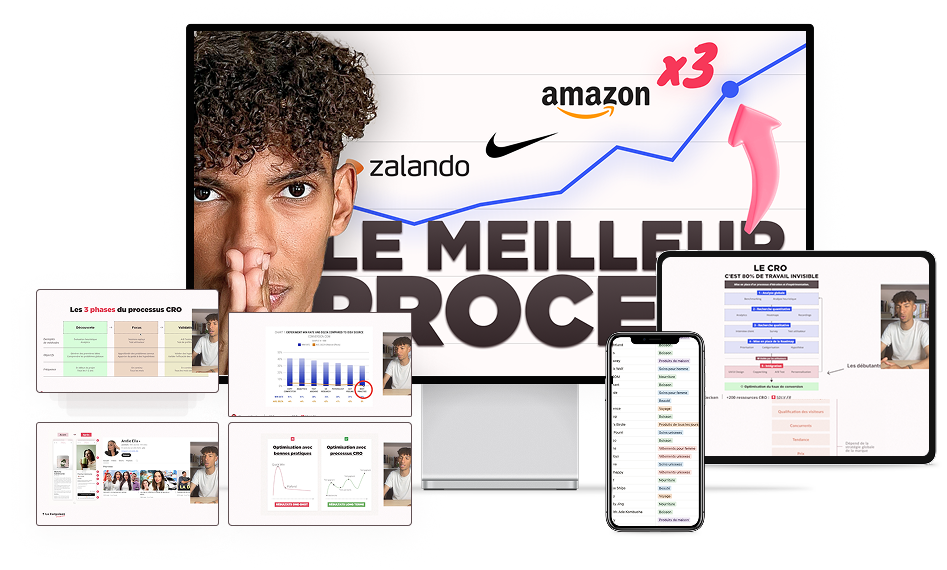

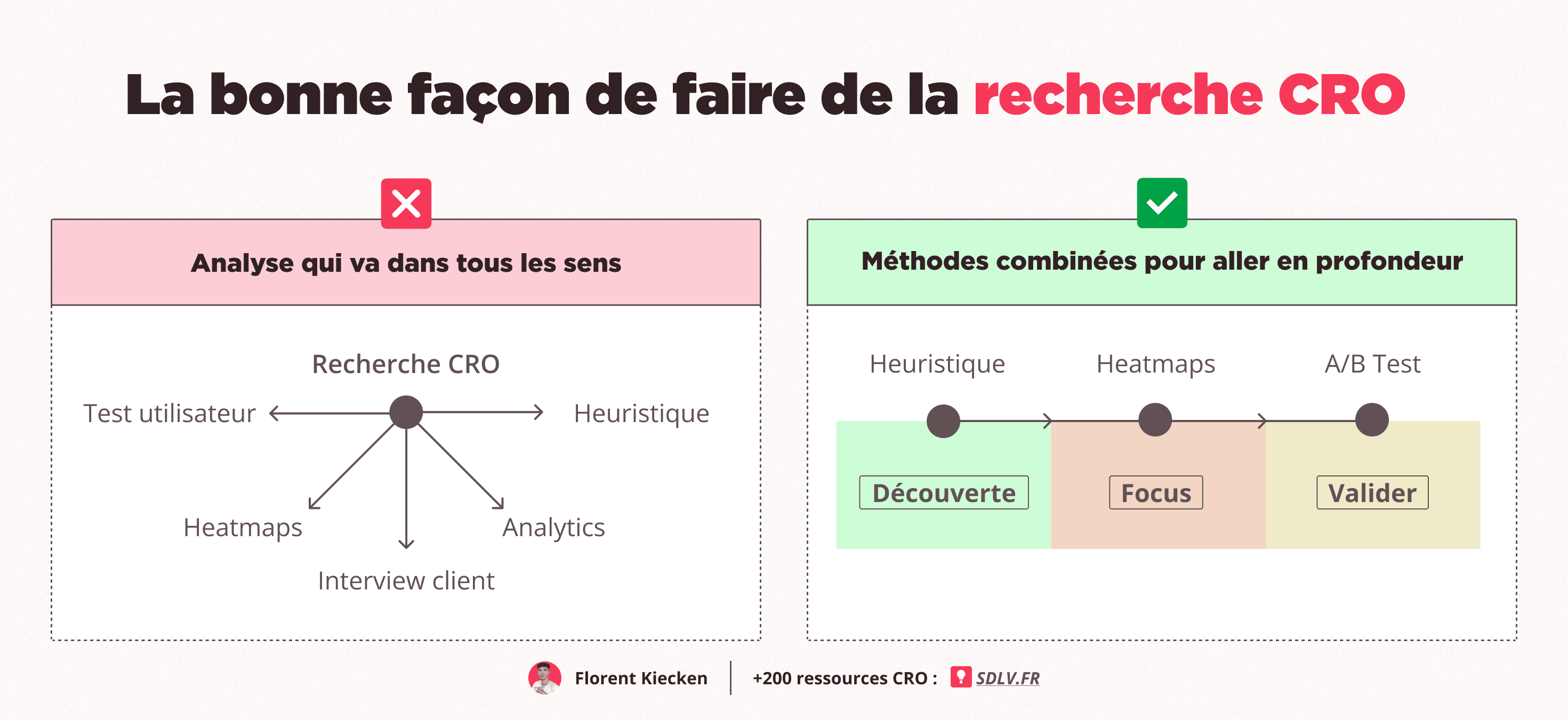

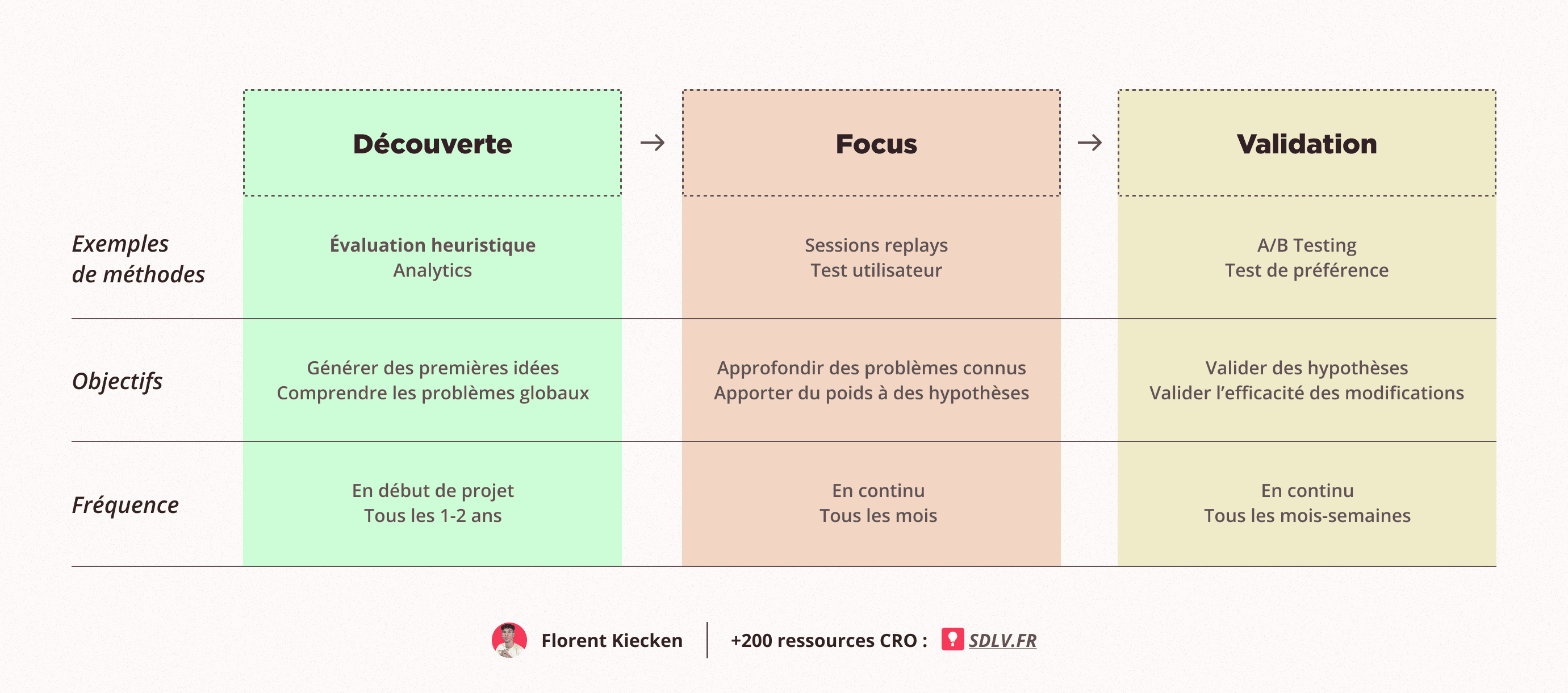

Toute la recherche CRO n'a pas le même objectif. Selon le stade où on se trouve dans le projet, on ne cherche pas la même chose. On distingue trois grandes phases.

La phase de Découverte intervient en début de projet ou lors d'un audit initial. L'objectif est de générer des premières idées et de comprendre les problèmes globaux du site. On s'appuie principalement sur l'évaluation heuristique et l'analyse des données analytics. C'est une phase qu'on réalise typiquement en début de projet, puis qu'on renouvelle tous les 1 à 2 ans.

La phase de Focus vise à approfondir des problèmes déjà identifiés et à apporter du poids aux hypothèses qu'on a formulées. On utilise des méthodes plus ciblées : session replays pour observer des parcours spécifiques, tests utilisateurs pour valider ou invalider une intuition. Cette phase tourne en continu, idéalement tous les mois.

La phase de Validation consiste à tester concrètement les modifications qu'on propose. A/B testing pour mesurer l'impact réel, tests de préférence pour comparer des variantes. Cette phase aussi est continue, avec un rythme hebdomadaire ou mensuel selon le volume de trafic.

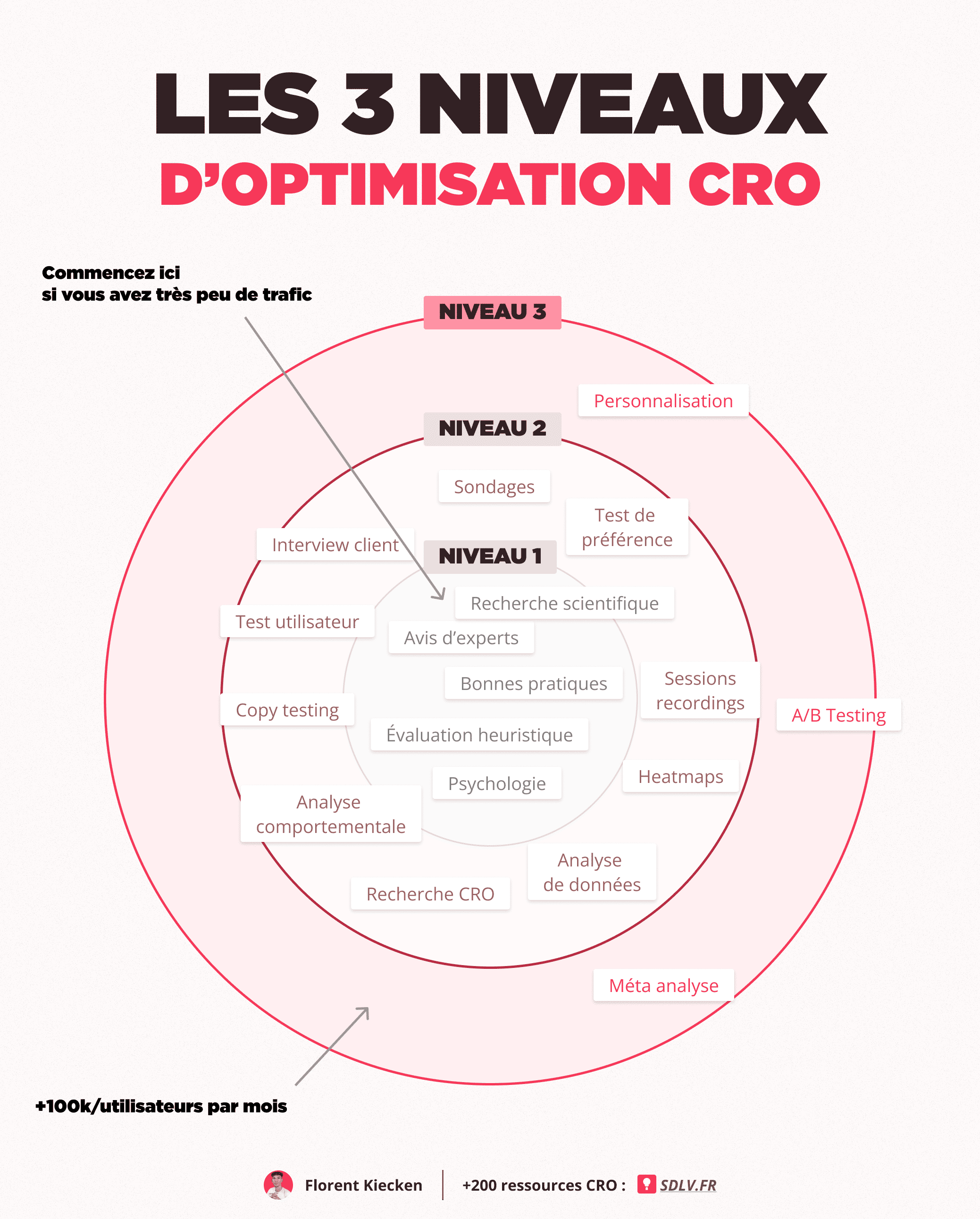

Un point important : toutes les entreprises n'ont pas besoin de toutes les méthodes dès le départ. Selon ton niveau de maturité CRO et ton volume de trafic, tu commences par des approches différentes.

Au Niveau 1 (peu importe le trafic), on s'appuie sur l'avis d'experts, les bonnes pratiques, l'évaluation heuristique et la psychologie cognitive. C'est la base, accessible à tout le monde.

Au Niveau 2, on ajoute les sondages, les interviews clients, les tests utilisateurs, le copy testing, les heatmaps, l'analyse comportementale et l'analyse de données. Ça demande plus de ressources mais ça enrichit considérablement la compréhension.

Au Niveau 3 (pour les sites à fort trafic, +100k utilisateurs/mois), on peut déployer l'A/B testing, les tests de préférence, la personnalisation et la méta-analyse des résultats de tests précédents.

L'erreur classique, c'est de vouloir commencer par le niveau 3 alors qu'on n'a pas les fondamentaux du niveau 1. L'A/B testing sans recherche en amont, c'est tester à l'aveugle.

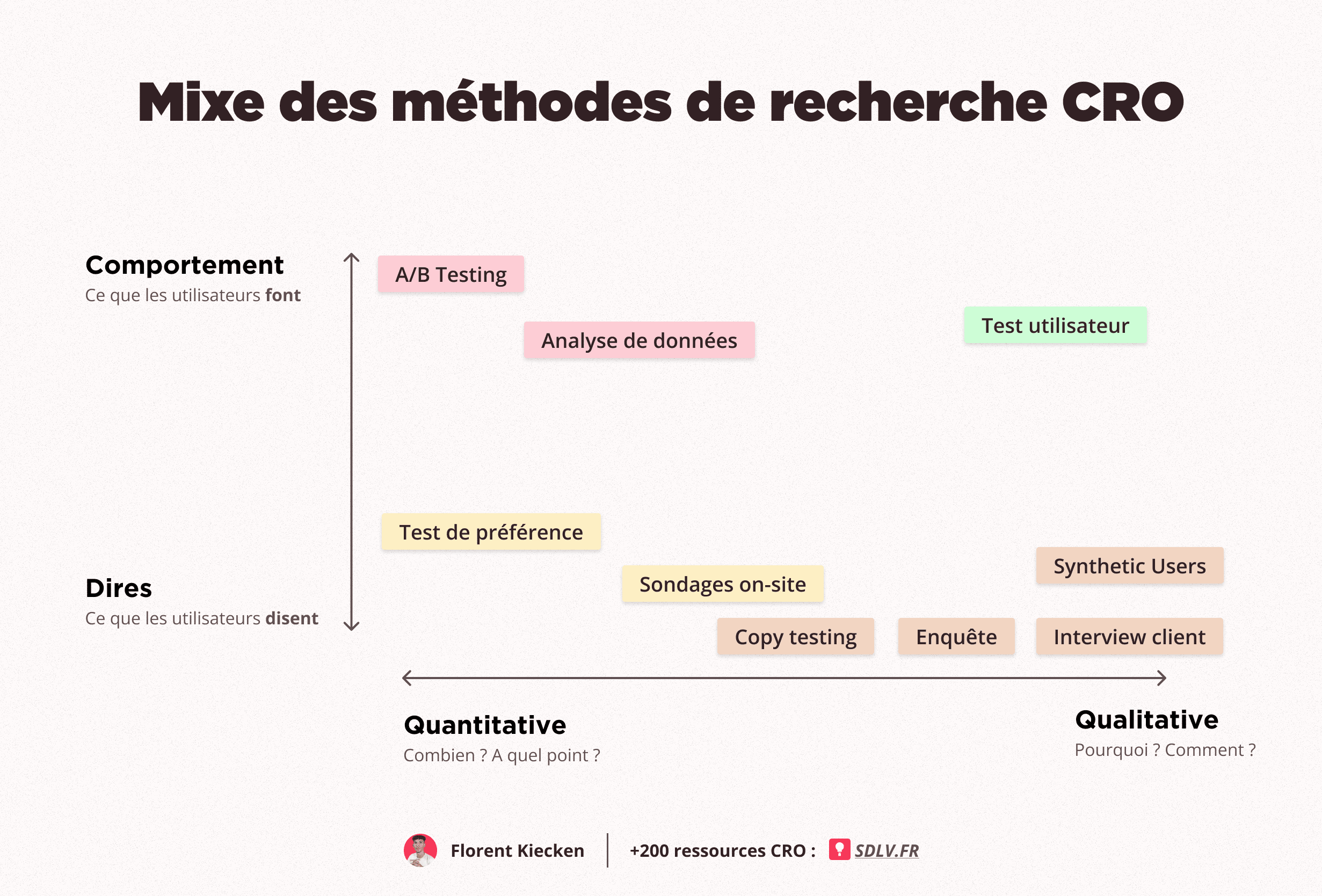

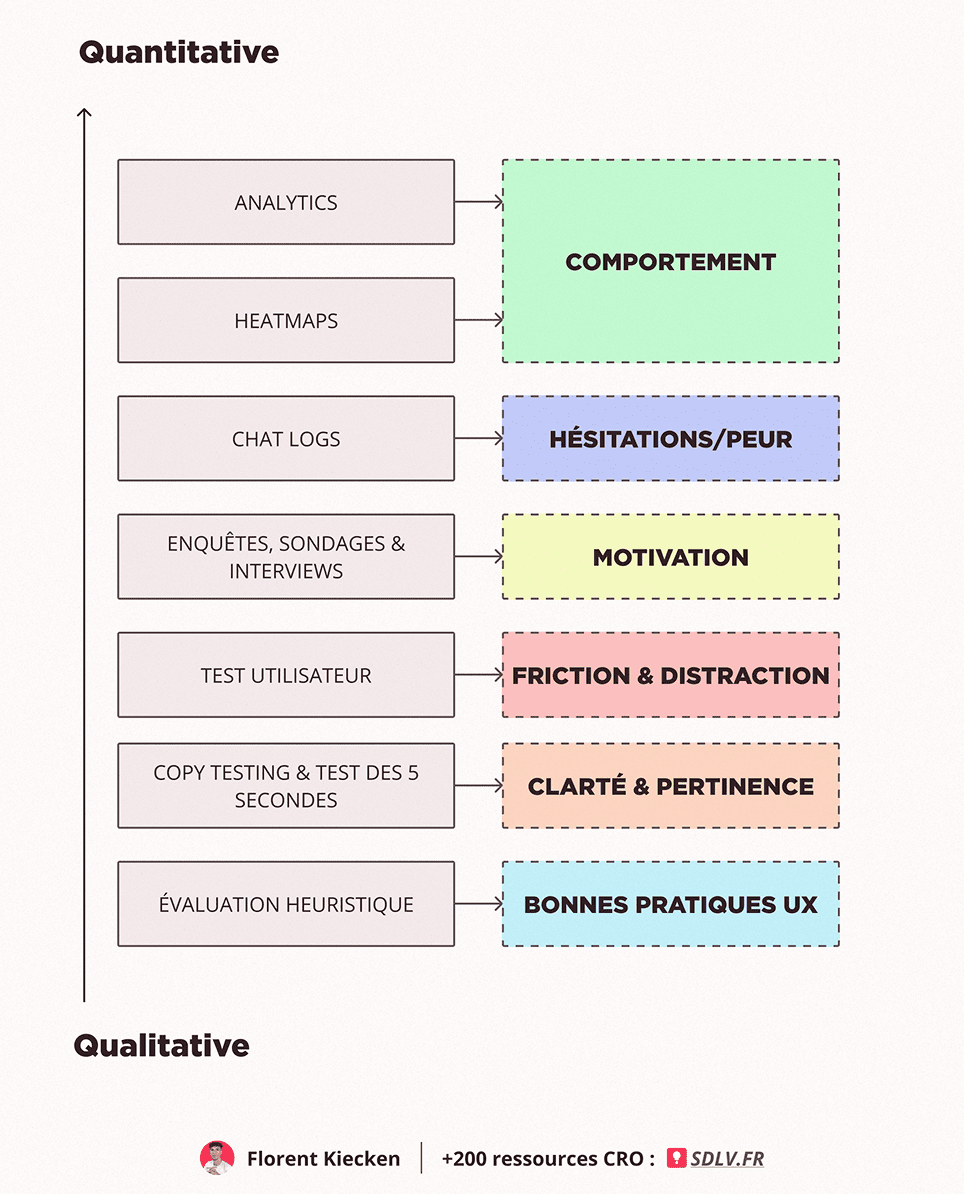

Chaque méthode de recherche répond à une question différente et révèle un type d'information spécifique. Le spectre va du purement quantitatif (ce que les gens font) au purement qualitatif (pourquoi ils le font).

L'A/B testing mesure l'impact réel d'une modification sur les conversions. C'est la méthode de validation ultime, mais elle nécessite un volume de trafic suffisant pour être statistiquement significative. On l'utilise en phase de Validation.

L'analytics (Google Analytics, Mixpanel, Amplitude…) permet de cartographier les flux de trafic, identifier les pages à fort taux de rebond, repérer les étapes du funnel où les utilisateurs décrochent. C'est le socle de toute recherche quantitative, à utiliser dès la phase de Découverte.

Les heatmaps (Hotjar, Microsoft Clarity, Contentsquare…) montrent visuellement où les utilisateurs cliquent, jusqu'où ils scrollent, et quelles zones de la page attirent l'attention. Elles révèlent souvent des comportements surprenants qu'on ne verrait pas dans les analytics classiques.

Les enquêtes on-site et les chat logs capturent les hésitations et les peurs des visiteurs au moment précis où ils les ressentent. Une question comme "Qu'est-ce qui vous empêche de finaliser votre commande ?" posée au bon moment peut révéler des freins qu'aucune donnée analytique ne montrerait.

Les sondages et interviews explorent les motivations profondes. Pourquoi les clients ont-ils choisi ton produit ? Qu'est-ce qui les a fait hésiter ? Quelles alternatives ont-ils considérées ? Ces insights sont précieux pour comprendre le contexte décisionnel.

Les tests utilisateurs consistent à observer des personnes réelles qui utilisent ton site en verbalisant leurs pensées. Ils révèlent les frictions et les distractions que personne en interne ne voit, simplement parce qu'on est trop proche du produit.

Le copy testing et le test des 5 secondes évaluent la clarté et la pertinence du message. Un utilisateur comprend-il ta proposition de valeur en 5 secondes ? Les mots que tu utilises sont-ils les bons pour ta cible ?

L'évaluation heuristique consiste à passer le site au crible de principes UX éprouvés. Elle permet d'identifier rapidement les violations de bonnes pratiques sans avoir besoin de recruter des testeurs.

La clé, c'est de combiner plusieurs méthodes. Un insight basé uniquement sur les analytics manque de contexte. Un insight basé uniquement sur 3 interviews manque de représentativité. Mais un insight soutenu par les analytics ET confirmé par des interviews ET visible dans les heatmaps — ça, c'est solide.

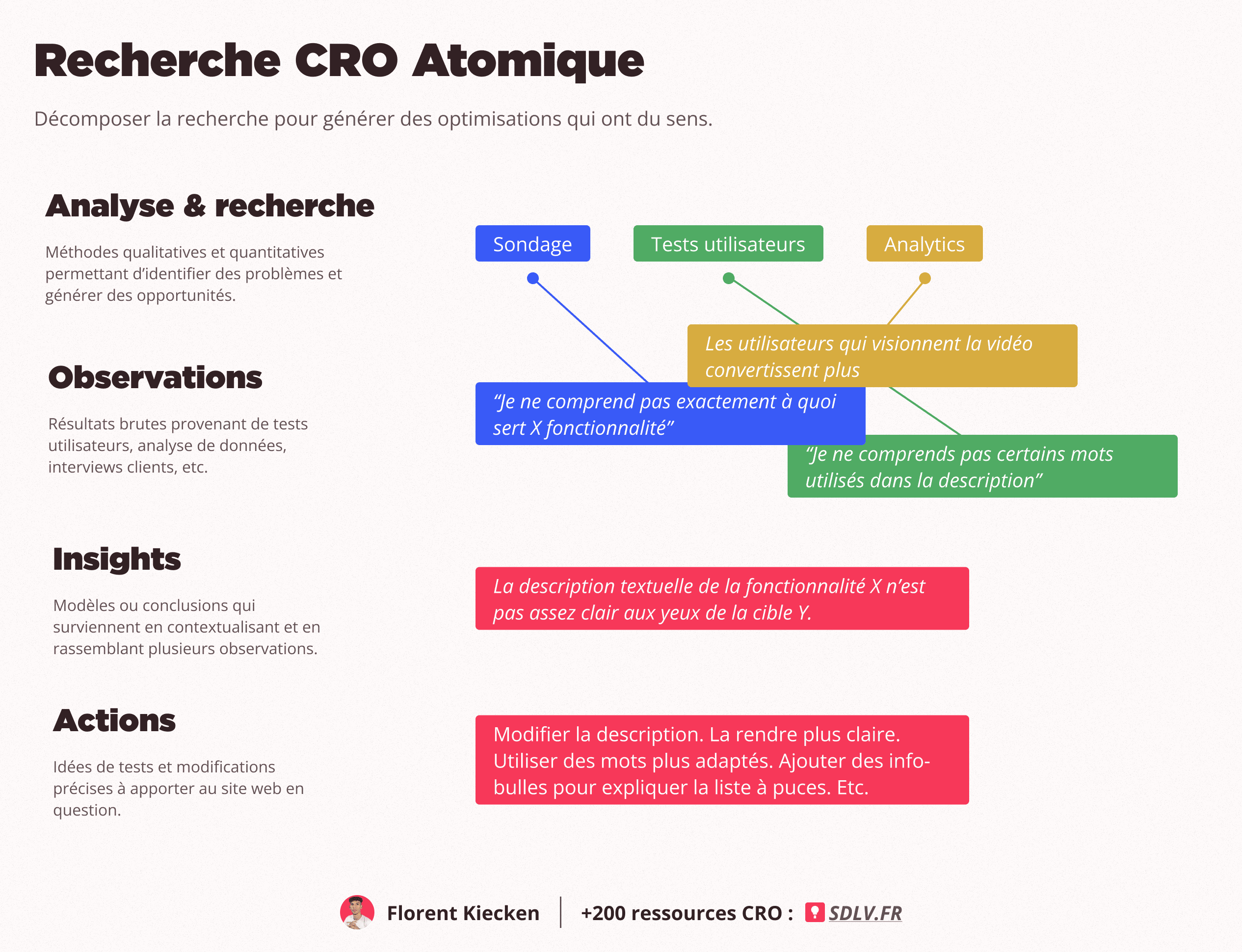

C'est probablement le concept le plus important de cet article. L'Atomic Research est un framework qui structure le passage de la donnée brute à l'action concrète, de manière traçable et systématique.

Le principe repose sur 4 niveaux distincts.

Le premier niveau, c'est l'analyse et la recherche : les méthodes qu'on utilise — sondage, tests utilisateurs, analytics, heatmaps, etc. C'est la source des données.

Le deuxième niveau, ce sont les observations. Ce sont les résultats bruts, non interprétés, tels qu'ils sortent de la recherche. Par exemple : "Les utilisateurs qui visionnent la vidéo produit convertissent 2x plus" (analytics), ou "Je ne comprends pas exactement à quoi sert cette fonctionnalité" (test utilisateur), ou encore "Je ne comprends pas certains mots utilisés dans la description" (interview client). Une observation est un fait, pas une interprétation.

Le troisième niveau, ce sont les insights. Un insight émerge quand on recoupe plusieurs observations et qu'un pattern apparaît. En croisant les trois observations ci-dessus, l'insight devient clair : "La description textuelle de la fonctionnalité X n'est pas assez claire aux yeux de la cible Y." C'est une conclusion actionnable, soutenue par plusieurs sources.

Le quatrième niveau, ce sont les actions. À partir de l'insight, on génère des idées concrètes de modification : modifier la description pour la rendre plus claire, utiliser des mots plus proches du vocabulaire de la cible, ajouter des info-bulles pour expliquer les termes techniques, intégrer une vidéo explicative puisqu'on sait qu'elle améliore la compréhension.

Le point essentiel de l'Atomic Research, c'est la traçabilité. Chaque action remonte à un insight. Chaque insight remonte à des observations. Chaque observation remonte à une méthode de recherche. Si quelqu'un te demande "pourquoi on teste ça ?", tu peux remonter toute la chaîne.

L'erreur la plus courante, c'est de sauter des étapes. On voit une observation ("les gens ne cliquent pas sur ce bouton") et on passe directement à l'action ("changeons la couleur du bouton"). Sans passer par l'insight, on optimise au doigt mouillé. Peut-être que le bouton n'est pas cliqué parce que le texte n'est pas clair, ou parce que l'offre ne convainc pas, ou parce que les utilisateurs n'en sont pas encore à cette étape dans leur parcours mental. L'insight, c'est ce qui donne la direction.

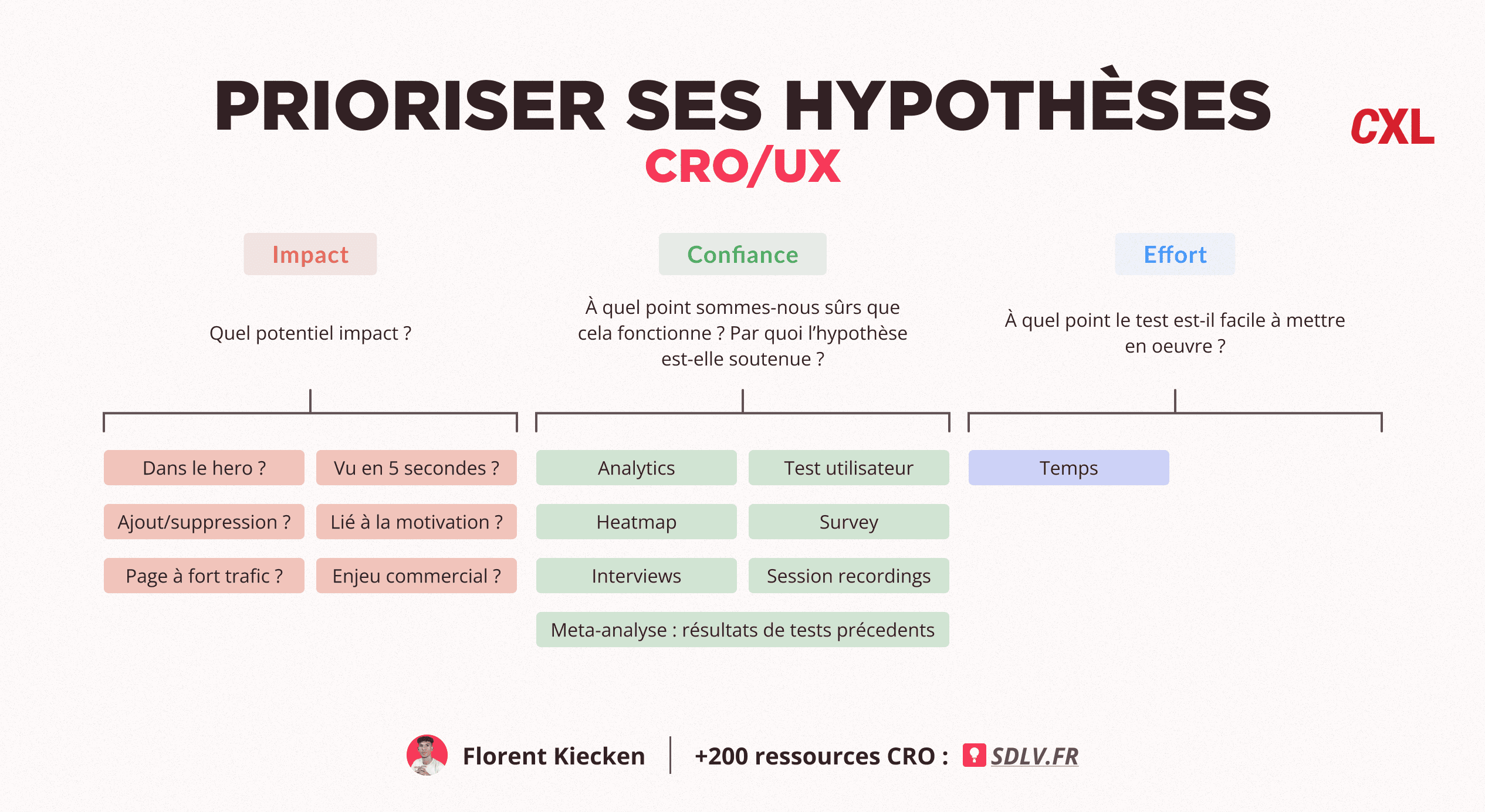

Une fois qu'on a accumulé des observations via différentes méthodes, il faut les organiser. C'est là qu'intervient le framework de priorisation.

Le modèle le plus efficace évalue chaque hypothèse sur trois dimensions :

L'Impact potentiel est évalué à travers une série de questions concrètes. La modification concerne-t-elle le hero de la page (la première zone visible) ? Est-elle visible en moins de 5 secondes ? S'agit-il d'un ajout ou d'une suppression d'élément ? Est-elle directement liée à la motivation d'achat ? Concerne-t-elle une page à fort trafic ? Y a-t-il un enjeu commercial majeur ? Est-ce un gros changement ou un micro-ajustement ? Plus on répond "oui" à ces questions, plus l'impact potentiel est élevé.

La Confidence mesure à quel point on est sûr que la modification va fonctionner. Et c'est là que la qualité de la recherche fait toute la différence. Une hypothèse soutenue par des données analytics solides, confirmée par des heatmaps, validée par des tests utilisateurs, appuyée par des surveys et des interviews, et cohérente avec les session recordings — cette hypothèse-là a un niveau de confiance très élevé. À l'inverse, une hypothèse basée uniquement sur l'intuition d'un stakeholder aura un score de confiance faible. La méta-analyse des résultats de tests précédents est aussi une source précieuse de confiance.

L'Effort est évalué sur deux critères simples : le temps nécessaire pour implémenter et tester la modification, et la facilité technique de mise en œuvre.

En combinant ces trois dimensions, on obtient un score qui permet de classer les hypothèses. L'idéal, c'est de commencer par les hypothèses à fort impact, haute confiance et faible effort.

Ce classement devient ta roadmap d'expérimentation. Chaque mois, tu prends les hypothèses en haut de la liste, tu les transformes en tests, tu analyses les résultats.

Et les résultats viennent enrichir ta base de connaissances : un test gagnant confirme un insight, un test perdant le nuance ou l'invalide. C'est la boucle d'apprentissage continue qui fait la force d'un vrai programme CRO.

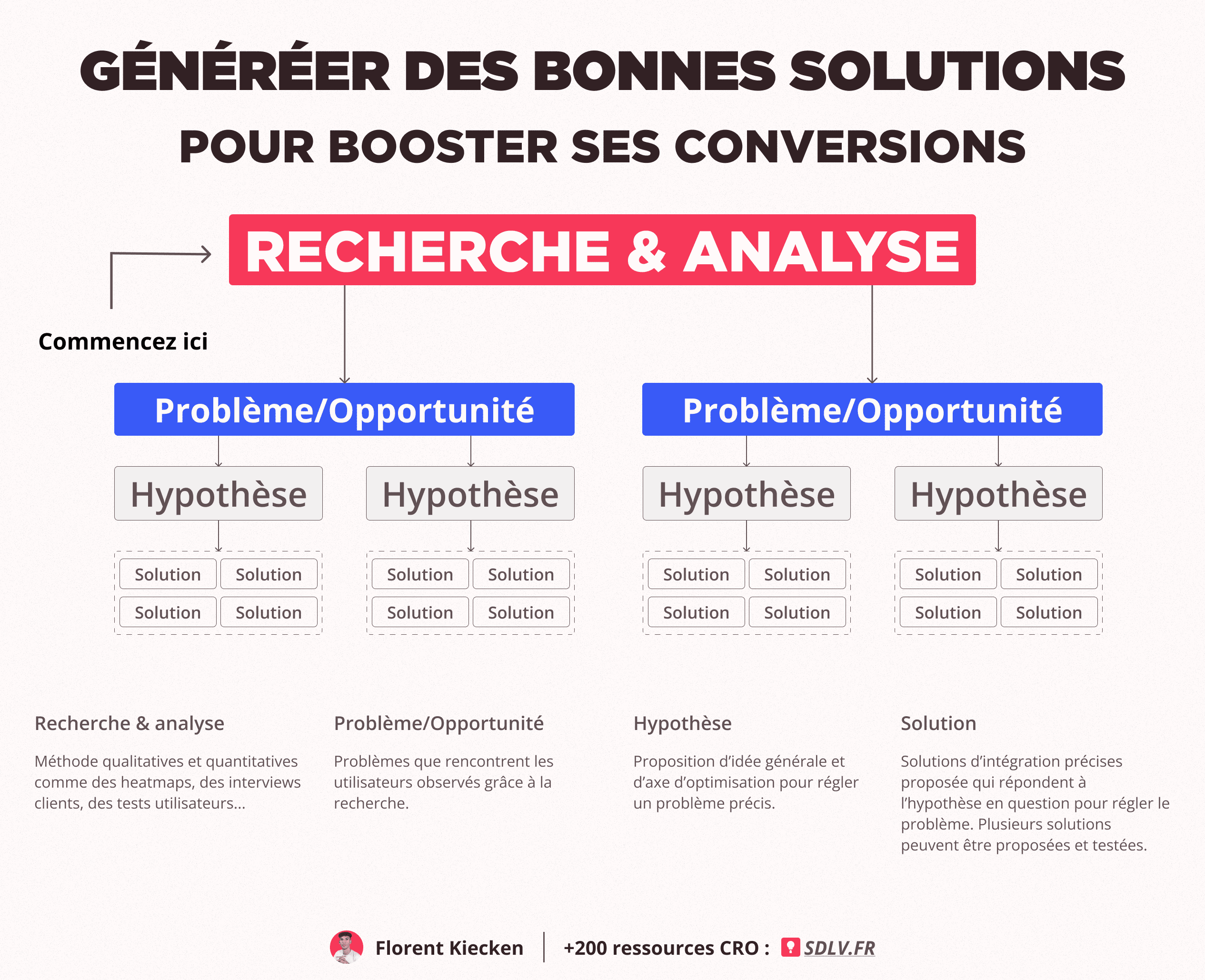

L'approche Recherche → Problème/Opportunité → Hypothèse → Solution(s) garantit que chaque test est ancré dans une réalité utilisateur. Plusieurs solutions peuvent être proposées et testées pour chaque hypothèse, ce qui multiplie les chances de trouver la bonne optimisation.

Un audit CRO, ce n'est pas un livrable qu'on produit une fois puis qu'on range dans un tiroir. C'est un processus vivant, une discipline qui combine rigueur analytique et empathie utilisateur.

Le parcours est toujours le même : observer (avec les bonnes méthodes), comprendre (en croisant les données pour faire émerger des insights), formuler des hypothèses (avec le framework Atomic Research), prioriser (avec un modèle Impact/Confidence/Effort), tester, apprendre, et recommencer.

Il n'y a pas de raccourci. La qualité de tes tests dépend directement de la qualité de ta recherche en amont. Et la qualité de ta recherche dépend de la diversité des méthodes que tu utilises et de ta capacité à en faire émerger des insights solides.

Le CRO n'est pas une loterie. C'est une méthode scientifique appliquée à l'expérience utilisateur. Et comme toute méthode scientifique, elle commence par l'observation.

%20(1).png)

« LE contenu CRO francophone de référence »

.svg)

.png)

+130 marques accompagnés